Enterprise Datenplattform mit Databricks Part 1

Will man heute eine moderne Datenlandschaft aufbauen, sieht man sich mit einem regelrechten Dschungel an Technologien, Sprachen, Frameworks und Plattformen konfrontiert, die alle versprechen, das Allheilmittel für komplexe Datenprobleme zu sein.

Um in dieser Vielfalt den Überblick zu behalten, sollte man zunächst grundlegende Fragen zum eigenen Business-Case beantworten können:

- Wie hoch ist die Datenkomplexität?

- Welche fachlichen und regulatorischen Anforderungen müssen erfüllt werden?

- Wie kurz ist das geforderte Time-to-Market Fenster?

- Soll die Plattform On-Premise, Cloud-native oder in einer hybriden Umgebung betrieben werden?

- Soll ein optimiertes, proprietäres Ökosystem genutzt werden oder wird die Flexibilität eines Open-Source Standards bevorzugt?

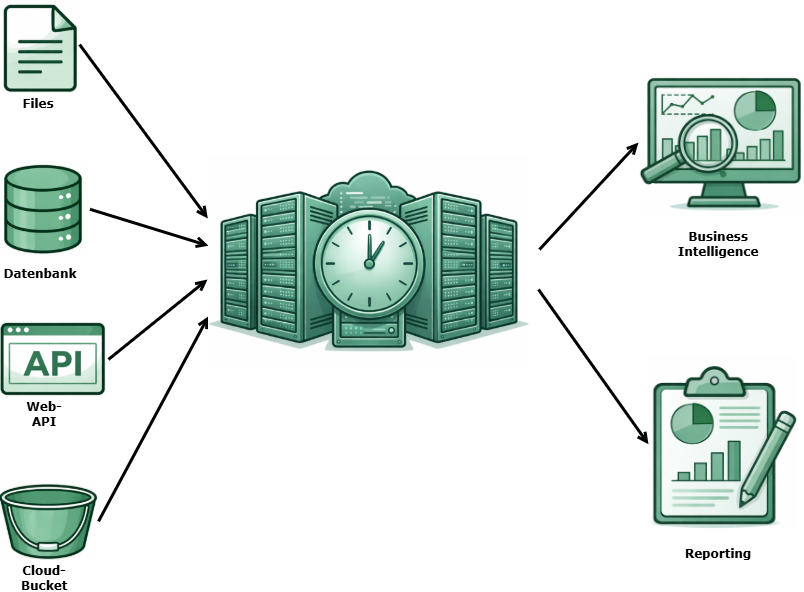

Visualisierung erstellt mit Unterstützung von KI (Gemini)

Das Rückgrat: Enterprise Data Integration mit Ab Initio

Für uns gilt die Formel: Je komplexer die Transformationslogik, je höher die Heterogenität der Datenlandschaft und je häufiger die strukturellen Änderungen in Quellsystemen sind, desto mehr entfaltet Ab Initio seine Stärke.

Genau dort, wo Business-Critical Reports, komplexe regulatorische Anforderungen, parallelisierte Verarbeitung massiver Datenmengen und eine lückenlose Data Lineage unverzichtbar sind, spielt Ab Initio in einer eigenen Liga.

Als langjähriger Partner von Ab Initio mit tiefgreifender Erfahrung in der Umsetzung von Ab Initio Projekten bei Enterprise Kunden unterstützen wir unsere Kunden dabei, dieses Potential voll auszuschöpfen.

Andere Wege: Agilität und Cloud-Native Speed

Die Anforderungen der Kunden verändern sich: Oft ist ein Cloud-Native Tech Stack gefragt, um der Dynamik moderner Datenlandschaften gerecht zu werden.

Gefordert sind kurze Entwicklungs- und Releasezyklen, eine minimale Time-to-Market, sowie eine schnellstmögliche Nutzbarkeit von Daten aus verschiedenen Quellen.

Für genau diesen Use Case wenden wir unsere bewährten Warehouse-Architekturen aus der Enterprise Umgebung in einem modernen Cloud Data Stack an. Wir komplementieren damit gezielt unser technologisches Spektrum, um für jede Anforderung die passende Antwort parat zu haben.

Die Kombination aus Databricks und dbt erlaubt es uns, diese bewährten Prinzipien in eine hochflexible, agile, Code-zentrierte Cloud-Umgebung zu transformieren.

Einer der Vorzüge liegt dabei in der einfachen Initialisierung der beiden Plattformen: Innerhalb weniger als einer Stunde kann man eine voll funktionsfähige Entwicklungsumgebung bereitstellen, wodurch der Weg vom Konzept bis zum produktiven Datenfluss massiv verkürzt wird.

Gesetzt wird dabei auf Python und SQL, zwei Sprachen, die auf einer sehr breiten Wissensbasis am Markt fußen.

Trotz der hohen Entwicklungsgeschwindigkeit bleibt dabei die Qualität nicht auf der Strecke: Durch das integrierte Testing- sowie Lineage-Framework von dbt sind automatisierte Qualitätskontrollen direkt im Entwicklungsprozess integriert.

So stellen wir sicher, dass unsere Expertise im Data Governance Bereich, die unsere Enterprise-Kunden gewohnt sind, auch in agilen Cloud Projekten gewahrt bleibt.

Das MVP-Projekt: In Rekordzeit zur Cloud-Data Plattform

Wir haben uns die Frage gestellt: Wie schnell lässt sich ein fundiertes Lakehouse-Architekturkonzept in einem modernen Cloud-Stack implementieren und welche Funktionalitäten sind für ein solches MVP-Projekt dabei unerlässlich?

Unser Anspruch dabei war, dass trotz einer minimalen Time-to-Market sämtliche Kernkomponenten einer professionellen Enterprise-Lösung abgedeckt sein müssen:

- Ingestion: Die Anbindung externer APIs sowie Zugriff auf Cloud Buckets erfolgt via Spark-Skripts.

- Layer-Architektur: Die konsequente Trennung der Verarbeitungslogik in einen Bronze (Raw), Silver (Cleansed) und Gold (Business) Layer innerhalb von Databricks.

- Business-Logik & Transformation: Sobald sich die Daten im Lakehouse befinden, nutzen wir dbt für sämtliche Transformationen. Dies garantiert nicht nur sauberen Code, sondern liefert ein Testing- sowie Lineage-Framework von Haus aus mit.

- Jobsteuerung & Orchestrierung: Über Databricks Workflows wird die gesamte Kette vom API-Call bis zum fertigen Datenmodell vollautomatisch orchestriert.

- Testing & Lineage: Durch das in dbt integrierte Testing-Framework führen wir automatisierte Qualitätschecks durch und stellen außerdem eine lückenlose Visualisierung der Lineage her.

- CI/CD-Integration: Um echte Release-Zyklen abzubilden, wurde der gesamte Stack über moderne CI/CD-Pipelines bereitgestellt, wobei wir dabei auf die Databricks Asset Bundle Funktionalität zurückgegriffen haben.

Unser MVP-Projekt verdeutlicht: Wir beherrschen nicht nur die komplexe Welt von Ab Initio, sondern sind gleichermaßen Experten für Databricks und moderne Cloud-Stacks.

Wir wissen, wie man die Brücke zwischen Governance-lastiger Enterprise Anforderungen und rasanter Cloud-Entwicklung schlägt, ohne dabei Kompromisse bei Qualität oder Stabilität einzugehen. Wir liefern nicht nur Code, sondern Architekturen, die bleiben.

Ausblick

Einen detaillierten Einblick in die Umsetzung der Kernkomponenten des MVP-Projekts liefern wir in der folgenden Blogreihe. Den Anfang macht hierbei Ingestion zur Anbindung externer APIs sowie Zugriff auf Cloud Buckets.